4月16日,Google AI Edge Gallery 更新了版本。不是什么小修小补,而是一次实质性的功能扩展——现在,你不仅可以在手机上跑 Gemma 4,还可以跑 DeepSeek 和 Qwen 了。

加上全新上线的 Agent Skills 功能,手机端 AI 的能力边界已经从「简单的问答」扩展到了「可执行多步骤任务的智能体」。这条赛道,正在快速升温。

🔄 发生了什么

4月16日的更新主要有两件事:

第一,模型范围扩大。此前 AI Edge Gallery 只支持 Google 自家的 Gemma 系列模型。这次更新后,应用内置的模型市场新增了对 DeepSeek(尤其是 DeepSeek-R2)和 Qwen(通义千问)系列的支持。用户不再需要手动配置,直接在 App 内搜索、下载、切换模型。

第二,Agent Skills 正式上线。这是这次更新最值得关注的点。Agent Skills 让 Gemma 4 可以在手机上执行多步骤任务——不是简单的单轮问答,而是「规划 → 调用工具 → 执行 → 反馈」的完整链路。

这意味着什么?意味着你的手机 AI 现在可以做事情了,而不只是回答问题。

⚡ Agent Skills 是怎么运作的

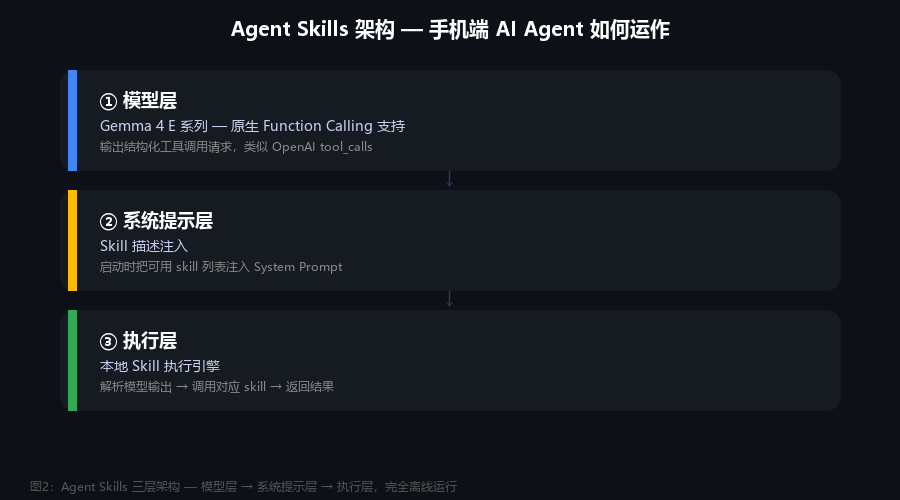

根据 CSDN 实测分析,Agent Skills 的实现链路分三层:

① 模型层:Gemma 4 E 系列原生支持 Function Calling,模型可以输出结构化的工具调用请求——这和 OpenAI 的 tool_calls 格式类似,但完全在本地执行。

② 系统提示层:App 启动时,会把可用的 skill 列表以「名称 + 描述 + 参数格式」注入 System Prompt。模型在推理时,会根据任务类型自动选择合适的 skill。

③ 执行层:本地 Skill 执行引擎解析模型输出,调用对应 skill,并将结果返回给模型,形成完整的工作流。

三层之间不需要网络连接,全部在手机上完成。这是从「问答工具」到「行动智能体」的关键跨越。

📱 你的手机能跑吗

版本支持情况:

- iOS:iOS 17.0+,iPhone 15 Pro 及以上(iPhone 16 系列体验最佳)

- Android:Android 12+,6 GB RAM 以上(推荐 8 GB+)

- macOS:macOS 14.0+,Apple M1 芯片及以上

模型大小参考:

- Gemma 4 E4B(推荐首选)— 约 3.6 GB

- DeepSeek-R2 — 约 4.1 GB

- Qwen3-4B — 约 2.8 GB

- Gemma 4 E2B(轻量快速)— 约 1.5 GB

🧩 功能全景

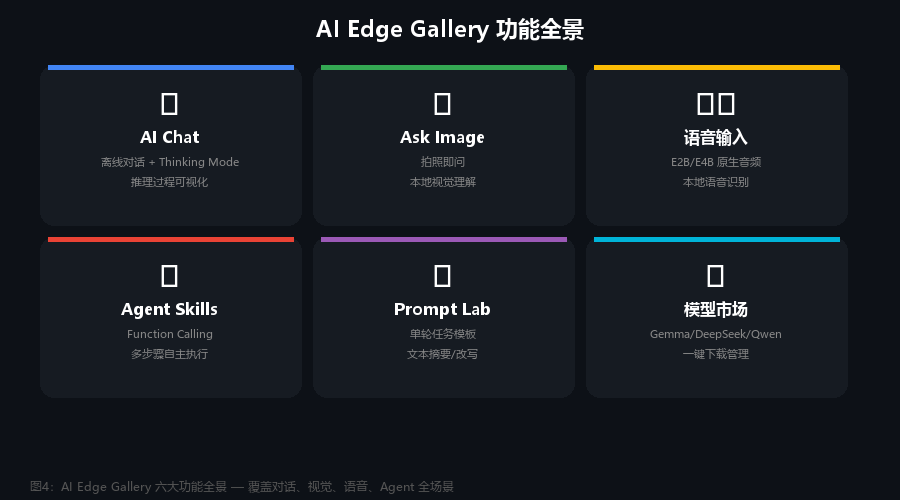

目前 AI Edge Gallery 提供的核心功能:

- AI Chat — 离线对话,支持 Thinking Mode,推理过程可视化

- Ask Image — 拍照即问,本地视觉理解,不上传任何数据

- 语音输入(E2B/E4B)— 原生音频输入能力,本地语音识别

- Agent Skills — 多步骤任务自主执行,Function Calling 驱动

- Prompt Lab — 单轮任务模板,文本摘要/改写

- 模型市场 — 一键下载管理 Gemma / DeepSeek / Qwen

💡 值得关注的趋势

AI Edge Gallery 的这次更新,背后的趋势值得多说几句。

过去一年,各家大厂都在推「本地 AI」的概念,但真正能落地的产品凤毛麟角。Google 这次的动作不一样——他们不只是开源了一个模型,而是构建了一套完整的产品和分发体系:

- 官方 App 直接上架 App Store / Google Play

- 模型市场覆盖多个厂商(Gemma / DeepSeek / Qwen)

- Agent Skills 把「本地 AI」从问答扩展到任务执行

加上 Gemma 4 本身的能力——Arena 开源排行榜全球第三,原生多模态,Apache 2.0 许可证——这个组合的威力正在慢慢释放。

对于普通用户,这意味着你的下一部手机,可能就是一个随身携带的 AI 工作站。