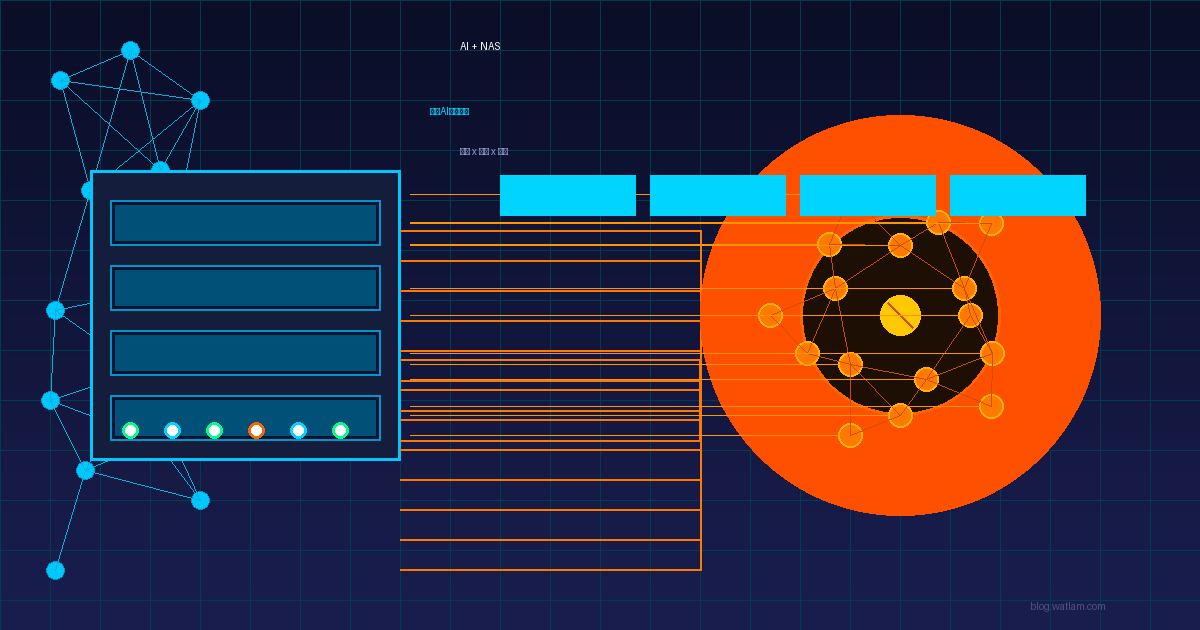

今年,NAS赛道突然冒出一个热词——AINAS(AI NAS)。继极空间率先打出”AI相册””AI字幕”之后,梵想、绿联等品牌也在2025年跟进,把大模型能力直接塞进了NAS里。存储不再只是”存”,而是”存+用+思考”。

🚀 梵想FX2510:DeepSeek直接跑在NAS上

梵想今年推出了升级版FX2510智能NAS,最大的亮点是全面集成了ChatGPT、DeepSeek、豆包等10余个主流AI模型接口。这意味着什么?

简单说,你的NAS不再只是一个私人网盘,而是一个本地AI助手:

- 📝 文本处理:直接调用DeepSeek写文案、总结文档

- 🖼️ 图像识别:本地AI对照片进行分类、OCR

- 🎙️ 语音交互:通过豆包等模型实现对话式操作

- 📊 多模态理解:跨文本、语音、图像的综合分析

💾 为什么是现在?

1. 大模型走向端侧

DeepSeek等开源模型的崛起,让本地部署成为可能。以前跑大模型需要高端GPU,现在消费级ARM芯片(比如瑞芯微RK系列)也能跑得动7B量级的模型。

2. QLC NAND成本下降

QLC颗粒让大容量SSD成本大幅降低,梵想FX2510这类产品用QLC做存储介质,价格压到千元档,不再是高不可攀的玩具。

3. 用户隐私意识增强

把数据存在本地、用本地AI处理,比上传云端更安全私密。AINAS恰好满足了这个需求——数据不离开你的硬盘。

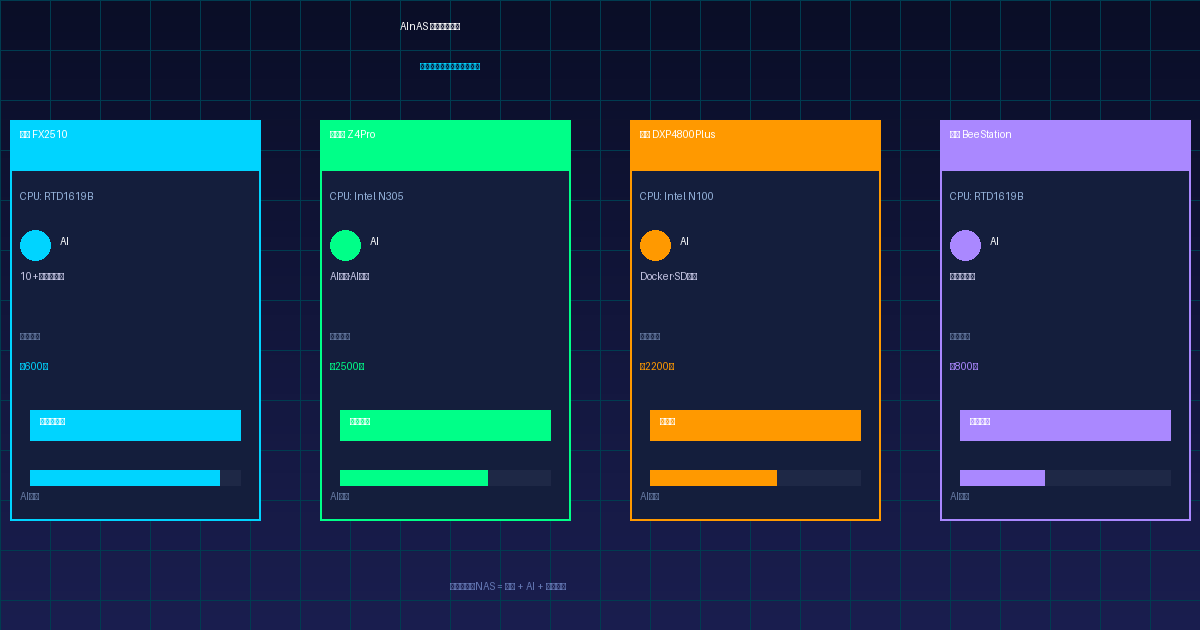

📊 主流AInAS产品一览

| 产品 | 处理器 | AI亮点 | 参考价格 |

|---|---|---|---|

| 梵想FX2510 | RTD1619B | 集成10+大模型 | 约600元起 |

| 极空间Z4Pro | N97/N305 | AI相册、AI字幕 | 约2500元起 |

| 绿联DXP4800Plus | Intel N100 | Docker部署SD | 约2200元起 |

| 群晖BeeStation | RTD1619B | 轻量私有云 | 约800元起 |

🤔 我的看法

说实话,AINAS现在还处于”能用但不够好用”的阶段。本地跑大模型的速度受限于芯片性能,响应延迟比云端API高不少。但这个方向是对的——随着芯片算力提升,未来的NAS一定是本地AI的数据中枢。

对于普通用户来说,如果你有隐私敏感的数据、又想要AI能力,AINAS是个值得关注的品类。

你看好AINAS这个方向吗?或者已经在用什么NAS跑AI了?欢迎留言交流。